Varonis est fier d’annoncer la disponibilité générale de Varonis Atlas, une plateforme de sécurité IA de bout en bout qui aide les organisations à visualiser et à contrôler l’IA dans toute l’entreprise.

Atlas est la seule plateforme qui couvre l'ensemble du cycle de vie de la sécurité de l'IA — de la découverte et de la gestion de la posture à la protection en temps réel et à la conformité — dans une seule solution. Elle se connecte à tout système d'IA que les organisations construisent ou gèrent : plateformes d'IA hébergées, LLM personnalisés, frameworks agentiques, chatbots et IA embarquée. Et comme Atlas repose sur la Plateforme Varonis de sécurité des données, il apporte un contexte de données qu'aucun outil de sécurité IA autonome ne peut égaler.

« L'IA bouleverse complètement le modèle de sécurité de l'entreprise. Au lieu que les humains naviguent à travers les interfaces utilisateur, les agents accèdent directement aux données — et cela place la sécurité des données et de l'IA au premier plan », a déclaré Yaki Faitelson, PDG et cofondateur de Varonis. « Si vous ne pouvez pas voir quels systèmes d’IA vous avez et quelles données sensibles ils peuvent atteindre, vous ne pouvez pas utiliser l’IA en toute sécurité à grande échelle. Varonis Atlas offre aux organisations le chemin le plus rapide vers une IA sûre et digne de confiance. »

Votre moyen le plus rapide vers une IA sûre et fiable

Les agents d'IA, les copilotes et les LLM sont désormais intégrés dans les flux de travail des entreprises. Ils lisent, écrivent et agissent sur les données à la vitesse d'une machine. Cependant, la plupart des organisations ne savent pas quels sont les systèmes d'IA dont elles disposent, à quoi ces systèmes peuvent accéder, ni s'ils sont conformes aux nouvelles réglementations.

Gartner® a récemment rédigé un rapport, intitulé « L’avenir de la sécurité de l’IA réside dans la sécurisation des actions des agents, pas des prompts », et dans leur analyse, les chercheurs ont découvert que plus de 50 % des organisations ont déjà commencé à déployer ou prévoient de déployer des agents IA. Les organisations se construisent également avec l'IA.

Le rapport prévoit que les plateformes de sécurité IA seront utilisées dans 30 % des organisations pour sécuriser le développement d’agents au sein du génie logiciel natif de l’IA, car la majorité croissante des ingénieurs logiciels d’entreprise s’appuient sur des outils de codage agentiques.

À mesure que les entreprises déploient des systèmes d’IA plus autonomes et agentiques, les risques augmentent :

- Les agents lisent, écrivent, créent et modifient des données en continu et à la vitesse d'une machine.

- L’accès aux données est souvent trop large et mal compris

- Les petites erreurs de configuration peuvent entraîner des fuites de données massives ou des amendes pour non-conformité

C'est pourquoi la sécurité de l'IA doit reposer sur la sécurité des données, et pourquoi Varonis Atlas existe. Atlas sécurise tout ce que vous construisez et gérez avec l'IA. Examinons ces capacités de plus près.

Un aperçu de la couverture de la plateforme Atlas tout au long du cycle de vie complet de la sécurité de l'IA

Un aperçu de la couverture de la plateforme Atlas tout au long du cycle de vie complet de la sécurité de l'IA

Capacités de sécurité d'Atlas AI

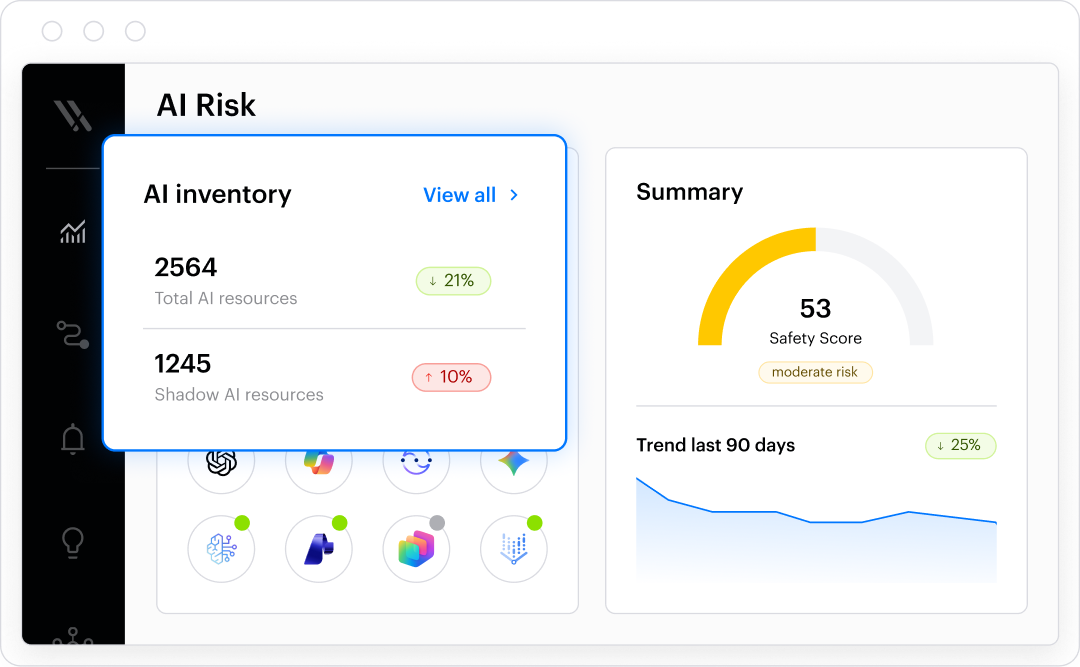

AI Inventory et Shadow AI

Varonis Atlas assure une découverte continue de tous les systèmes d'IA au sein de l'entreprise, y compris les outils autorisés, les agents personnalisés, l'IA embarquée et la Shadow AI utilisée sans autorisation formelle. En analysant les comptes cloud, les référentiels de code, les plateformes d'IA et l'utilisation de SaaS, Atlas construit un inventaire dynamique qui montre quelle IA existe, comment elle est connectée, à quelles données elle peut accéder et quelles actions elle peut effectuer — formant ainsi la base de tout autre contrôle de sécurité de l'IA.

- Allez au-delà de la simple découverte de surface : Atlas recense les agents, les modèles, les outils, les serveurs MCP, les dépendances et l’infrastructure de support, et pas seulement les points de terminaison LLM ou les applications de chat.

- Détectez Shadow AI grâce au contexte : les ressources d'IA découvertes sont liées aux utilisateurs, à l'accès aux données et au contexte d'activité, ce qui rend la shadow AI immédiatement exploitable au lieu de simplement visible.

Découvrez en continu les actifs, les projets et les systèmes d'IA, y compris Shadow AI, dans l'ensemble de votre environnement.

Découvrez en continu les actifs, les projets et les systèmes d'IA, y compris Shadow AI, dans l'ensemble de votre environnement.

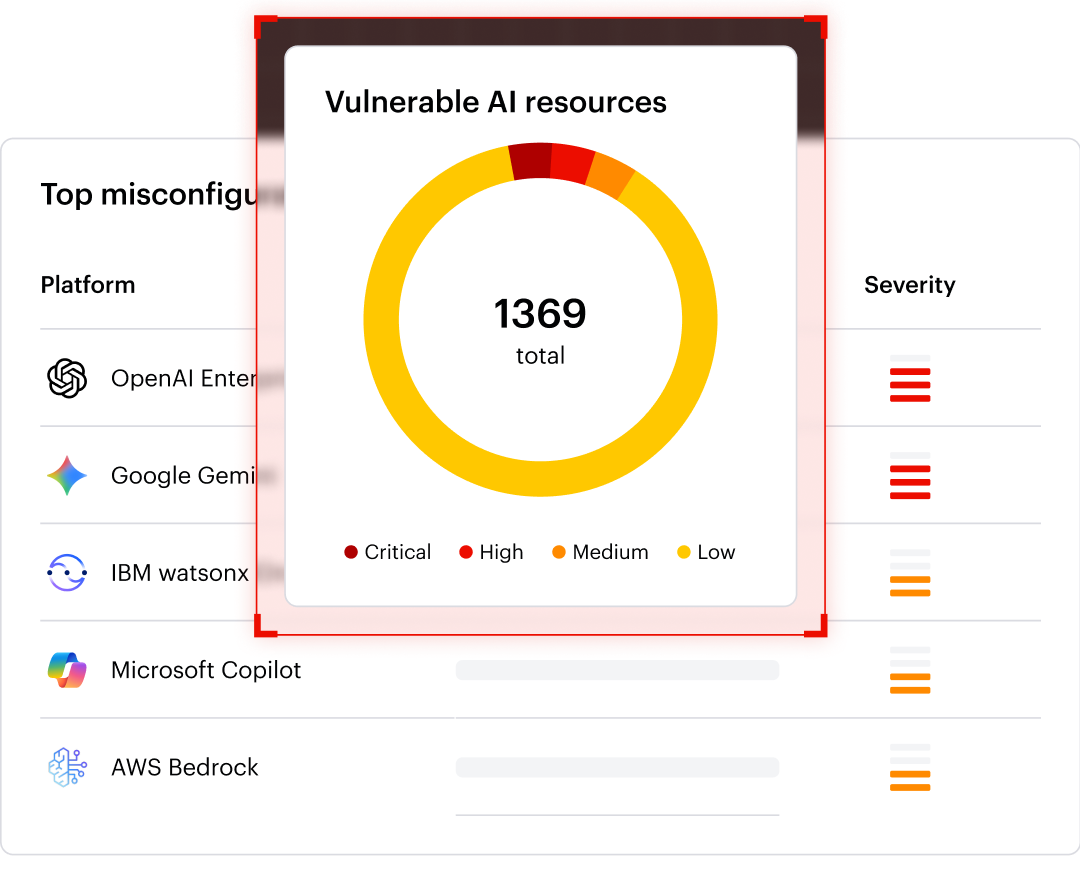

Gestion de la posture de sécurité de l'IA (AI-SPM)

Atlas AI Security Posture Management évalue en continu les systèmes d'IA pour détecter les vulnérabilités, les erreurs de configuration, l'exposure de données sensibles et les risques agentiques sur l'ensemble de la pile IA. Il analyse le code, les Prompts, les modèles, les dépendances et les configurations pour mettre en évidence les problèmes de sécurité concrets et les lier directement aux actifs et aux données d'IA qu'ils affectent. Cette approche globale permet aux équipes de remédier aux risques avant que les systèmes d'IA n'atteignent la production ou l'échelle.

- Une approche axée sur les données, et pas seulement sur la vérification des modèles : les résultats sont enrichis par le contexte de sensibilité et d’accès aux données de la plateforme Varonis de sécurité des données, révélant ainsi les risques commerciaux réels.

- Conçu pour les entreprises à grande échelle : AI-SPM couvre les plateformes cloud, les frameworks d’agents, les modèles personnalisés et l’IA tierce — pas un seul environnement de développement ou cas d’utilisation.

Analysez vos agents d'IA, vos chatbots et vos modèles pour détecter les vulnérabilités et les mauvaises configurations.

Analysez vos agents d'IA, vos chatbots et vos modèles pour détecter les vulnérabilités et les mauvaises configurations.

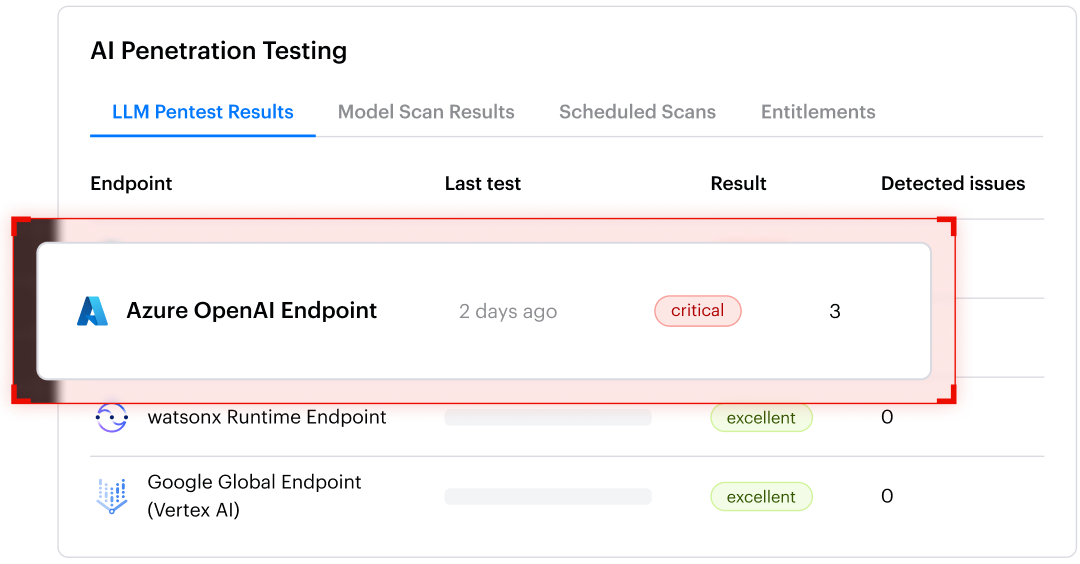

Tests d'intrusion IA

Atlas teste de manière proactive les systèmes d'IA en exécutant des prompts adverses et des attaques dynamiques contre les endpoints LLM en direct. Seule une analyse en temps réel permet aux équipes de déceler tous les problèmes potentiels. Ces tests simulent donc des menaces réelles telles que l'injection de prompt, les jailbreaks et les tentatives de contournement de politique, puis enregistrent les comportements dangereux comme des résultats concrets de sécurité liés directement aux modèles, agents et configurations concernés.

- Tests dynamiques en direct : Les tests d'intrusion s'exécutent sur des points d'extrémité de production réels, et non sur des simulations hors ligne ou des vérifications de règles statiques.

- Application en aval : les résultats des tests d'intrusion informent directement les garde-fous d'exécution et les politiques de posture, bouclant la boucle du test à la protection.

Testez proactivement vos systèmes d'IA pour les vulnérabilités telles que l'injection de prompts et les débridages.

Testez proactivement vos systèmes d'IA pour les vulnérabilités telles que l'injection de prompts et les débridages.

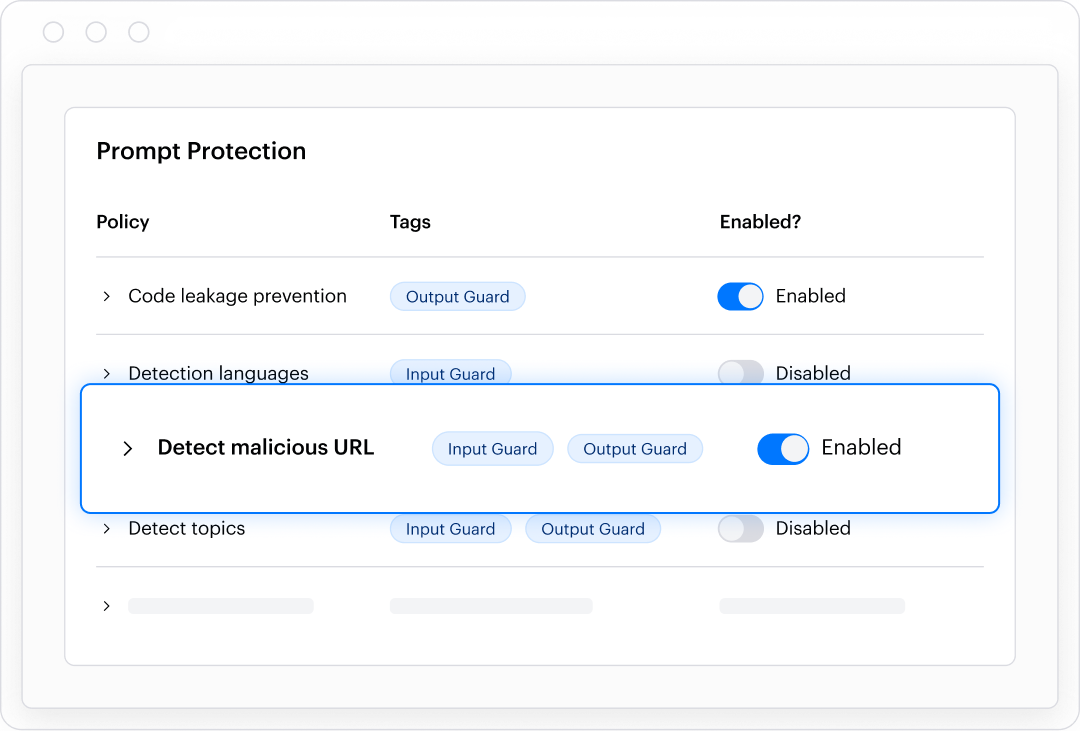

Garde-fous d'exécution IA

Atlas met en place des garde-fous en temps réel grâce à une passerelle IA qui s’insère dans le chemin des requêtes en temps réel, en inspectant les prompts, les réponses et les actions des agents avant qu’ils n’atteignent le modèle ou les systèmes en aval. Ces contrôles empêchent les fuites de données sensibles, bloquent les comportements malveillants ou non conformes et génèrent des Alerts en temps réel — sans nécessiter de modifications de l’application d’IA ou du modèle sous-jacent.

- Blocage et application de politiques compatibles avec l'IA : Les garde-fous comprennent le flux d'exécution, les outils d'agent et les chemins de fuite indirects — pas seulement une simple correspondance de motifs.

- Plan de données appartenant au client : Les prompts, les réponses et la télémétrie restent dans l'environnement du client, ce qui répond aux exigences en matière de résidence et de souveraineté des données.

Appliquez des politiques en temps réel qui empêchent la fuite de données sensibles et bloquent l'utilisation malveillante et non conforme de l'IA.

Appliquez des politiques en temps réel qui empêchent la fuite de données sensibles et bloquent l'utilisation malveillante et non conforme de l'IA.

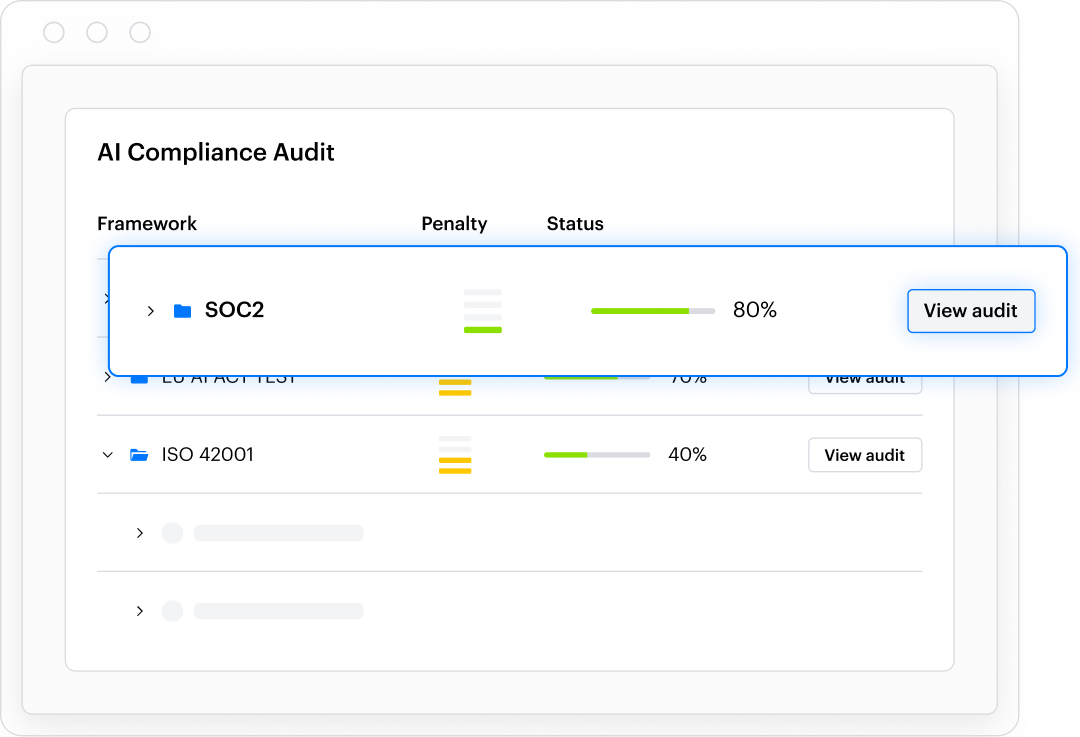

Conformité et gouvernance de l'IA

Atlas rend opérationnelle la gouvernance de l'IA en cartographiant en continu les systèmes d'IA par rapport aux cadres réglementaires tels que le Règlement sur l'intelligence artificielle de l'UE (AI Act) et le Cadre de gestion des risques de l'IA du NIST. La plateforme génère des rapports prêts à être audités, maintient les artefacts de traçabilité et de transparence, et suit les évaluations des risques et le statut de la remédiation — transformant la conformité d'un exercice ponctuel en un processus continu, étayé par des preuves.

- Fondé sur des preuves système réelles : le reporting de conformité s’appuie sur un inventaire IA en temps réel, des graphiques de traçabilité, des logs d'activité et des données de sécurité — et non pas uniquement sur des questionnaires.

- Intégration unifiée aux contrôles de sécurité : La gouvernance est directement liée à la découverte, à la posture, aux tests d’intrusion et à l’application en temps réel, évitant ainsi la fragmentation des outils GRC.

Obtenez des rapports d'audit prêts à l'emploi pour valider votre conformité avec les réglementations et cadres en matière d'IA en constante évolution.

Obtenez des rapports d'audit prêts à l'emploi pour valider votre conformité avec les réglementations et cadres en matière d'IA en constante évolution.

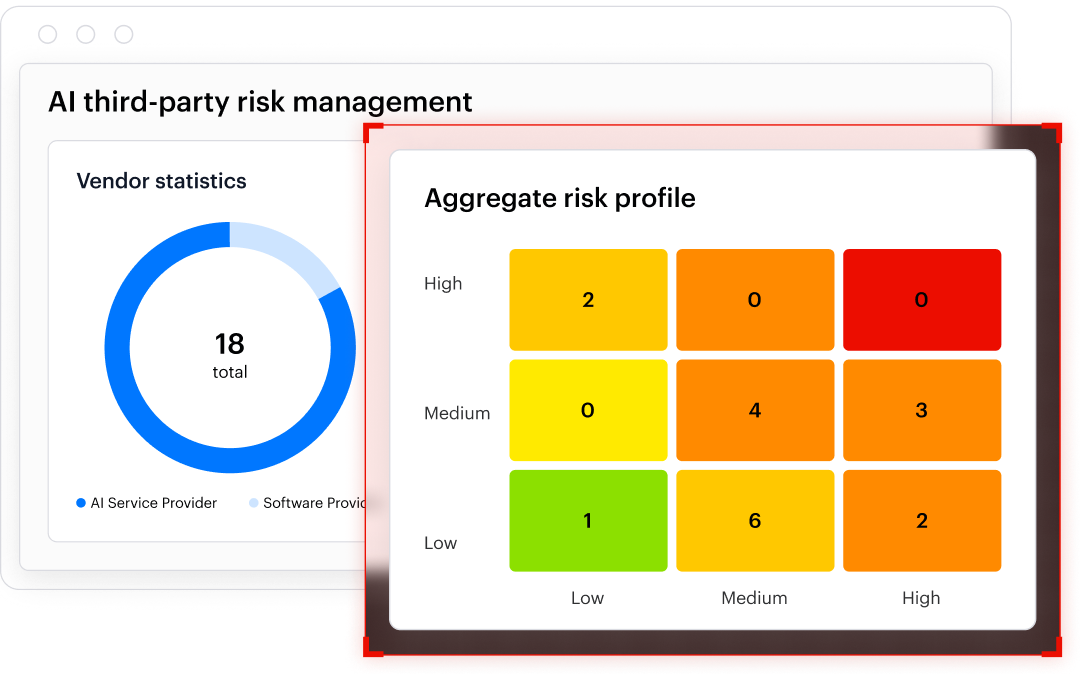

Gestion des risques liés à l'IA par des tiers (AI TPRM)

Varonis Atlas étend la sécurité de l'IA au-delà des systèmes construits en interne pour inclure les services, modèles et plateformes d'IA que les organisations consomment via leur chaîne d'approvisionnement. Il évalue continuellement les fournisseurs tiers d’IA en combinant leur inventaire d’IA ou leurs listes de matériaux d’IA (AIBOM) avec les réponses aux questionnaires des fournisseurs pour comprendre comment les systèmes d’IA externes gèrent les données et peuvent créer des risques dus à des dépendances spécifiques. Cela permet aux organisations d'identifier, de suivre et de remédier aux risques liés à l'IA tierce dans le cadre d'un cycle de vie de sécurité de l'IA unifié.

- En continu, pas à un moment précis : le risque lié à l'IA tierce est réévalué en permanence à mesure que les informations, les dépendances ou les comportements des fournisseurs changent, au lieu de se fier à des évaluations statiques.

- Intégration à l'inventaire de l'IA : les systèmes d'IA tiers sont suivis parallèlement aux actifs d'IA internes, ce qui permet une analyse des risques et une visibilité automatisées.

Gérez l'utilisation de l'IA dans les produits et services que vous consommez par le biais de votre chaîne d'approvisionnement, et prenez le contrôle des risques liés aux tiers.

Gérez l'utilisation de l'IA dans les produits et services que vous consommez par le biais de votre chaîne d'approvisionnement, et prenez le contrôle des risques liés aux tiers.

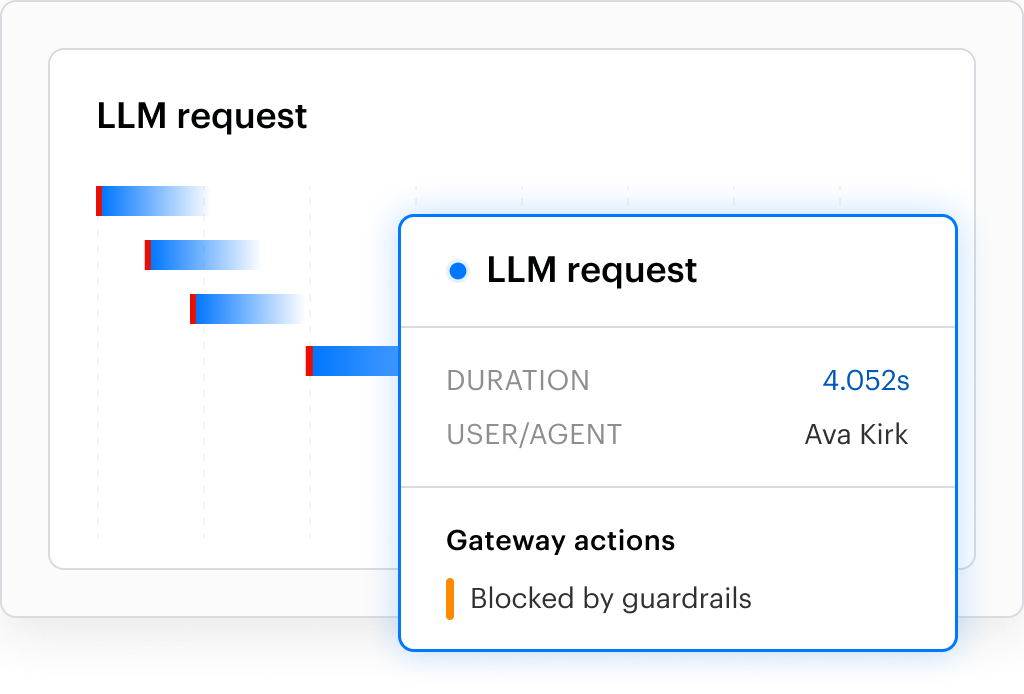

Suivi des activités de l'IA

Atlas AI Activity Monitoring offre une visibilité de bout en bout sur le comportement des systèmes d'IA en production en capturant les prompts, les réponses, les actions des agents, l'accès aux données et les décisions des garde-fous. Grâce à une couche d’observabilité appartenant au client et à des tableaux de bord centralisés, les équipes de sécurité et de gouvernance peuvent comprendre comment l’IA est utilisée, détecter les comportements anormaux et enquêter sur les incidents avec un contexte d’exécution complet à travers les modèles, agents et outils.

- Visibilité complète de l'exécution : la surveillance couvre les Prompts, les réponses, les appels d'outils des agents et l'accès aux données, et pas seulement les Logs de conversation des utilisateurs ou les sorties des modèles.

- Télémétrie appartenant au client : tous les Logs d’activité de l’IA sont conservés dans l’environnement du client, ce qui facilite l’auditabilité, la résidence des données et les enquêtes médico-légales.

Consultez une piste d'audit complète des flux d'interactions IA de bout en bout, y compris les appels LLM, l'accès aux données, les appels aux outils et les garde-fous.

Consultez une piste d'audit complète des flux d'interactions IA de bout en bout, y compris les appels LLM, l'accès aux données, les appels aux outils et les garde-fous.

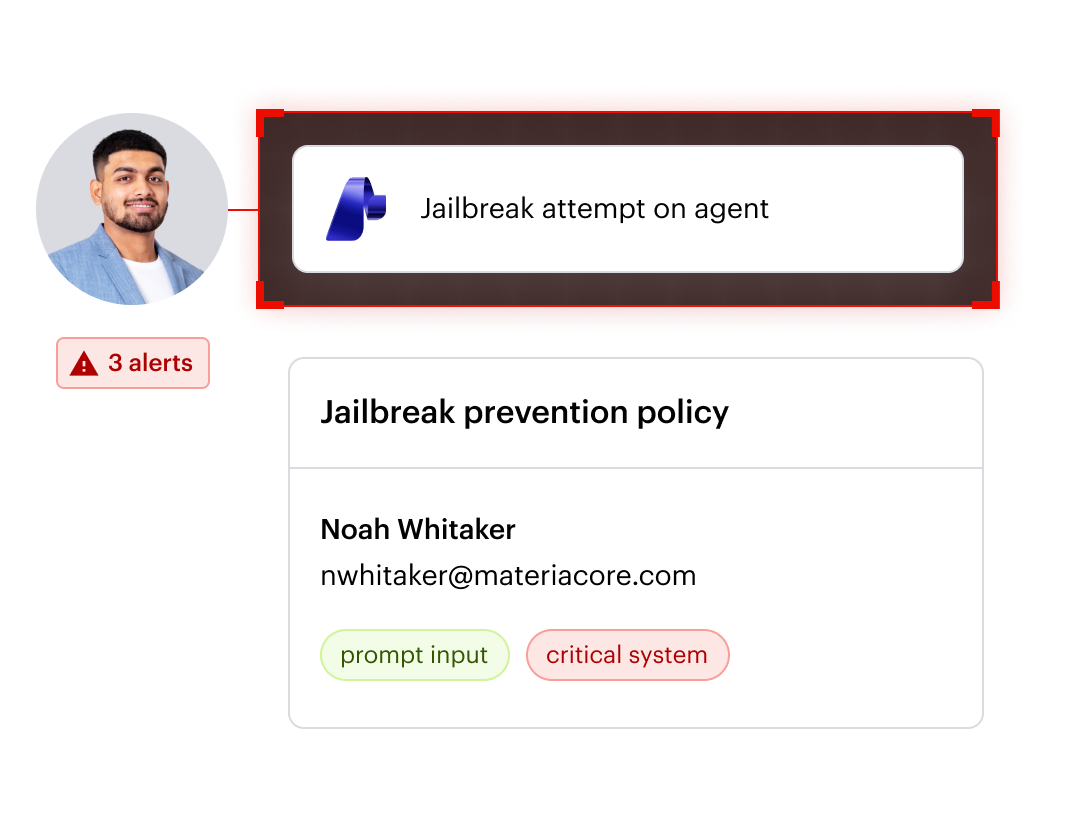

Détection d'IA et réponse (AIDR)

Varonis Atlas fournit une détection et une réponse de l'IA (AIDR) en identifiant en temps réel les comportements malveillants, dangereux ou non conformes de l'IA dans les modèles, les agents, les outils et les flux de données. Lorsque des menaces telles que des injections de prompt ou des tentatives de jailbreak sont détectées, Atlas génère des alerts exploitables, bloque l'activité en ligne si nécessaire et s'intègre aux plateformes SIEM et SOAR pour permettre une enquête et une réponse rapides.

- Détection des menaces par l'IA : L'AIDR comprend les techniques d'attaque spécifiques à l'IA et le comportement des agents plutôt que de s'appuyer sur les signaux traditionnels de sécurité des applications.

- Unification avec la sécurité des données : Les détections sont enrichies par la sensibilité des données et le contexte d'accès, ce qui permet aux équipes de hiérarchiser les incidents en fonction de l'impact réel sur l'entreprise.

Détectez et surveillez toute utilisation de l'IA avec une piste d'audit complète de bout en bout et générez des Alerts en temps réel.

Détectez et surveillez toute utilisation de l'IA avec une piste d'audit complète de bout en bout et générez des Alerts en temps réel.

L'IA sécurisée et les données qui l'alimentent

La sécurité de l'IA ne peut pas exister dans des silos ou des solutions ponctuelles. Cela exige une approche unifiée qui se connecte aux données dont dépend l'IA. À mesure que les organisations développent l'IA, leur exposure augmente également. La seule façon d'avancer est de mettre en place une sécurité qui comprenne à la fois le comportement de l'IA et les données qu'elle peut atteindre.

« La plupart des outils de sécurité IA sont fragmentés et aveugles aux données. Ils peuvent inventorier vos systèmes d'IA ou surveiller les prompts, mais ils ne peuvent pas voir à quelles données sensibles l'IA accède ni contrôler ce qu'elle fait de ces données.

Ron Bennatan, vice-président de la stratégie IA et sécurité des données chez Varonis, cofondateur de AllTrue.ai, créateur de Guardium (acquis par IBM) et jSonar (acquis par Imperva)

Varonis Atlas est disponible aujourd'hui. Commencez par regarder la vidéo de démonstration ci-dessous ou faites un essai gratuit avec un accès complet à l'inventaire de l'IA d'Atlas, à la gestion de la posture de sécurité, aux tests de sécurité, aux garde-fous d'exécution et à la fonctionnalité de reporting de conformité.

Que dois-je faire maintenant ?

Vous trouverez ci-dessous trois solutions pour poursuivre vos efforts visant à réduire les risques liés aux données dans votre entreprise:

Planifiez une démonstration avec nous pour voir Varonis en action. Nous personnaliserons la session en fonction des besoins de votre organisation en matière de sécurité des données et répondrons à vos questions.

Consultez un exemple de notre évaluation des risques liés aux données et découvrez les risques qui pourraient subsister dans votre environnement. Cette évaluation est gratuite et vous montre clairement comment procéder à une remédiation automatisée.

Suivez-nous sur LinkedIn, YouTube et X (Twitter) for pour obtenir des informations sur tous les aspects de la sécurité des données, y compris la DSPM, la détection des menaces, la sécurité de l’IA et plus encore.

.png)

.png)