Sam Altman ha lanciato un serio avvertimento: l'impersonificazione con AI non è una minaccia futura, ma un pericolo già in atto.

Il CEO di OpenAI prevede che l'imitazione audio e video generata con l'intelligenza artificiale verrà presto utilizzata per rapinare banche e commettere frodi su larga scala, definendola un rischio di “livello crisi” per il sistema finanziario.

E Altman non è il solo a lanciare l'allarme. Un recente report di Axios ha evidenziato una crescente preoccupazione tra i legislatori riguardo all'uso dell'intelligenza artificiale per clonare voci e volti a fini di truffa, frode e furto d'identità. In un contesto come questo, ignorare la minaccia può avere effetti nefasti.

Man mano che gli aggressori acquisiscono la capacità di imitare voci, volti e persino modelli comportamentali con una precisione sorprendente, i metodi tradizionali di verifica dell'identità, come password, domande di sicurezza o persino il riconoscimento facciale, stanno rapidamente diventando obsoleti.

Continua a leggere per scoprire di più sull'uso improprio dell'AI e vedere come Varonis aiuta le organizzazioni a reagire, rilevando i tentativi di impersonificazione con AI, bloccando la compromissione delle identità e proteggendo i dati sensibili prima che un utente ingannato possa concedere l'accesso o rivelare le proprie credenziali.

Le frodi basate sull'AI sono sempre più astute. E noi?

Secondo il report IBM 2025 sul costo delle data breach, il 16% delle violazioni ora coinvolge aggressori che utilizzano l'AI, più spesso per il phishing (37%) e l'impersonificazione tramite deepfake (35%).

Questi attacchi non sono solo più convincenti, ma anche più veloci ed economici da eseguire: l'intelligenza artificiale generativa ha infatti ridotto il tempo necessario per creare un'email di phishing o uno script di chiamata da 16 ore a soli 5 minuti.

E l'impatto finanziario è notevole. Le violazioni basate sull'AI costano alle organizzazioni una media di 4,49 milioni di dollari. Gli attacchi spesso eludono i sistemi di rilevamento tradizionali sfruttando la fiducia umana, il che li rende più difficili da individuare e più dannosi se raggiungono l'obiettivo.

La recente ondata di violazioni su Salesforce orchestrata da Scattered Spider (UNC3944) e UNC6040 (conosciuta anche come ShinyHunters) è un esempio inquietante dei nuovi sviluppi. Questi gruppi non hanno avuto bisogno di sfondare la porta: hanno convinto qualcuno ad aprirla per loro.

Sicurezza dell'identità e dei dati: la vostra ultima linea di difesa

La prevenzione da sola non è sufficiente. Ci saranno sempre utenti che soccomberanno a falsi video e audio convincenti, e i team di sicurezza devono dare per scontato che una violazione, prima o poi, si verificherà.

Le organizzazioni devono quindi essere in grado di rilevare e contenere i rischi legati all'IA per ridurre rapidamente al minimo i danni e l'impatto di una violazione. Ciò richiede un approccio stratificato:

- Adottare un approccio moderno alla sicurezza delle identità: implementare un'autenticazione resistente al phishing (ad esempio con passkey), applicare la gestione del ciclo di vita delle credenziali e monitorare sia le identità umane che quelle non umane. Se un utente fornisce erroneamente le proprie credenziali o informazioni al telefono, l'attaccante non sarà teoricamente in grado di aggirare queste misure.

- Tornare alle basi della sicurezza dei dati: i dati sensibili devono essere protetti tramite crittografia, controlli di accesso e gestione delle chiavi. Le soluzioni di sicurezza dei dati consapevoli dell'AI possono rilevare modelli di accesso anomali e prevenire l'esfiltrazione. Ad esempio, agli utenti dovrebbe essere impedito di condividere dati altamente sensibili con un utente esterno tramite email, anche se credono di rispondere a una richiesta dell'amministratore delegato.

- Controllare il blast radius: il 90% delle organizzazioni ha file sensibili di M365 esposti a tutti i dipendenti. Gli attacchi deep fake e di clonazione vocale hanno successo quando riescono ad accedere a un account con privilegi ampi e profondi. Automatizzando la remediation delle autorizzazioni, invece, gli aggressori non ottengono l'accesso esteso che desiderano dopo essersi introdotti nei sistemi aziendali.

Le violazioni sono inevitabili, i danni no. Le organizzazioni che utilizzano ampiamente l'intelligenza artificiale e l'automazione durante tutto il ciclo di vita della sicurezza risparmiano in media 1,9 milioni di dollari per violazione e risolvono gli incidenti 80 giorni più rapidamente.

Queste soluzioni accelerano il rilevamento, riducono gli avvisi non necessari e consentono risposte più rapide e precise. Inoltre, aiutano i team di sicurezza ad ampliare le loro risorse senza dover espandere il personale, un aspetto cruciale in un settore piagato da una persistente carenza di talenti.

Come Varonis aiuta a bloccare le frodi di identità generate con AI prima che si diffondano

Se gli aggressori utilizzano l'intelligenza artificiale per impersonare dirigenti senior o altre autorità ed esfiltrare dati sensibili, le organizzazioni necessitano di più che semplici firewall e autenticazione a più fattori (MFA). Hanno invece bisogno di visibilità in tempo reale su chi sta accedendo a cosa, e se è lecito che lo faccia.

È qui che entra in gioco Varonis:

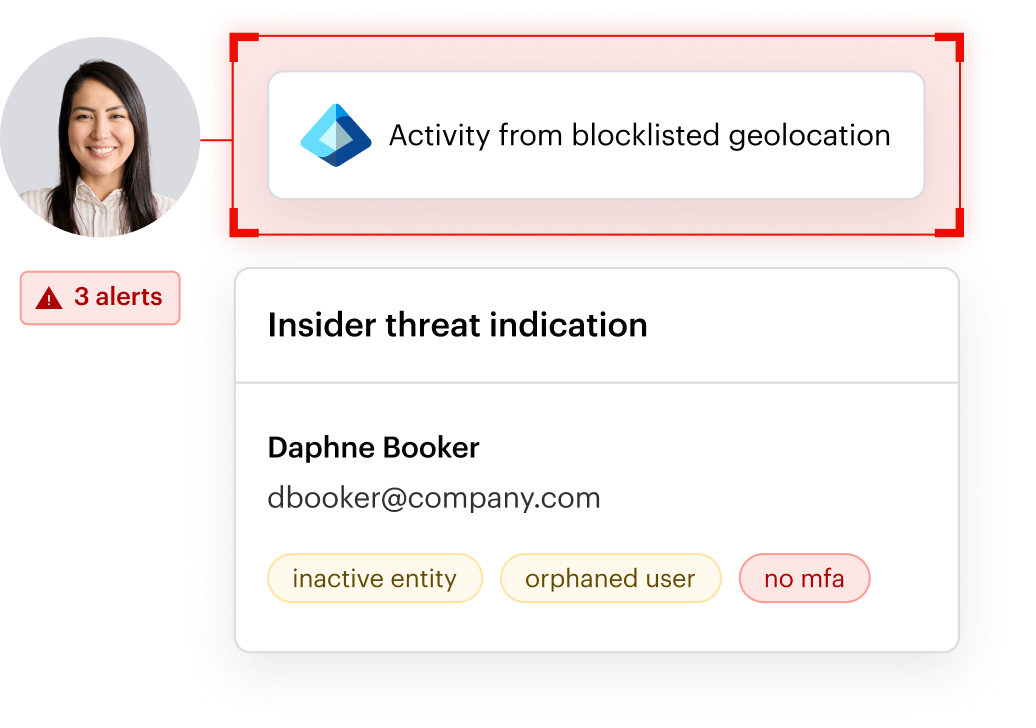

- Identity Threat Detection and Response (ITDR): Varonis monitora continuamente il comportamento degli utenti e segnala le attività sospette, come un utente che accede improvvisamente a grandi volumi di file sensibili o effettua l'accesso da luoghi insoliti. Questo è fondamentale quando gli aggressori utilizzano i deepfake per trafugare credenziali ed entrare nei sistemi con un semplice login, anziché forzare l'accesso.

Rileva gli account compromessi da vishing o inganni con deepfake, grazie a una soluzione ITDR a tutto tondo.

Rileva gli account compromessi da vishing o inganni con deepfake, grazie a una soluzione ITDR a tutto tondo.

- Sicurezza incentrata sui dati: la nostra Data Security Platform leader del settore rileva e classifica automaticamente i dati sensibili, mappando chi vi ha accesso e come li utilizza. Se un utente è compromesso e la sua attività dimostra che accede a qualcosa a cui non dovrebbe accedere, Varonis blocca la minaccia in tempo reale e ti avverte.

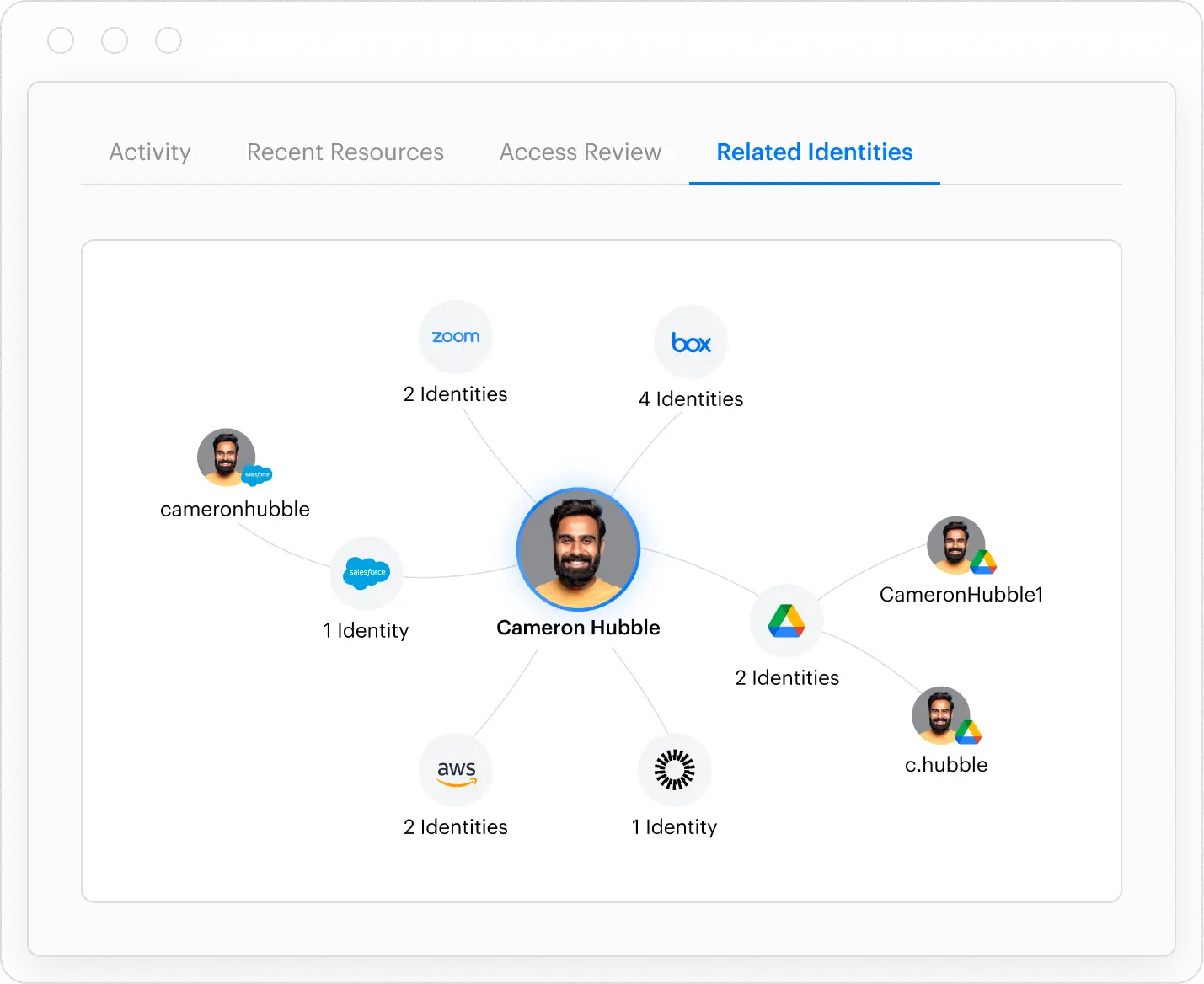

- Risoluzione delle identità: Varonis associa in modo fluido gli account dell'intero ecosistema di un'organizzazione a una singola persona, correlando inoltre ruoli, appartenenze e privilegi. La visibilità viene quindi migliorata utilizzando tecniche di apprendimento automatico comprovate per classificare quali account associati a quell'utente sono privilegiati, esecutivi, di servizio, esterni o non umani e macchine. Se un utente cade vittima di un attacco di vishing, i team di sicurezza possono quindi comprendere e bloccare facilmente l'accesso a decine di risorse cloud.

Mappa senza problemi le identità e gli utenti tra più ambienti cloud e on-prem.

Mappa senza problemi le identità e gli utenti tra più ambienti cloud e on-prem.

- Risposta automatica: quando viene rilevata una minaccia, Varonis mette automaticamente in quarantena gli utenti, revoca l'accesso o può attivare flussi di lavoro di risposta agli incidenti — riducendo al minimo i danni prima che si moltiplichino.

In un mondo in cui gli aggressori possono falsificare la tua voce, il tuo volto e le tue credenziali, Varonis ti offre la visibilità e il controllo per fermarli prima ancora che agiscano.

Non aspetti che il deepfake arrivi sulla Sua scrivania

Gli aggressori ormai usano strumenti di AI generativa per clonare voci, falsificare video e manipolare la fiducia su larga scala. Anche la tua organizzazione sarà presa di mira? La vera domanda non è se, ma quando.

Ora è il momento di agire. Verifica la tua esposizione, rafforza la tua postura di sicurezza dei dati e delle identità, e crea strategia di risposta alle violazioni incentrata sulla resilienza.

Inizia con una Data Risk Assessment gratuita. In meno di 24 ore, avrai una visione chiara e basata sul rischio dei tuoi dati più importanti e un percorso chiaro verso la remediation automatizzata.

O que devo fazer agora?

Listamos abaixo três recomendações para reduzir os riscos de dados na sua organização:

Agende uma demonstração conosco Veja a usabilidade de Varonis em uma sessão personalizada com base nas necessidades de segurança de dados da sua organização. Responderemos a todas as suas perguntas.

Veja um exemplo do nosso Relatório de Risco de Dados Conheça as ameaças que podem permanecer no seu ambiente. O Relatório da Varonis é gratuito e demonstra claramente como realizar a remediação automatizada.

Siga-nos no LinkedIn, YouTube et X (Twitter) Obtenha insights detalhados sobre todos os aspectos da segurança de dados, incluindo DSPM, detecção de ameaças, segurança de IA, entre outros.