In tutti i settori, le organizzazioni stanno implementando chatbot e agenti basati sull'AI, sviluppando applicazioni di AI e sfruttando una moltitudine di piattaforme, modelli e framework di agenti di AI per accelerare la produttività e creare nuove offerte di prodotti. L'adozione dell'AI sta accelerando a un ritmo tale che i team di sicurezza non riescono a stare al passo.

Mentre l'83% delle organizzazioni dichiara di utilizzare l'AI, solo il 13% ha una chiara visibilità su come questa interagisce con i dati sensibili. Ciò rende le organizzazioni incapaci di individuare una nuova generazione di minacce.

Questo cambiamento introduce nuove minacce, come l'avvelenamento della catena di approvvigionamento e l'iniezione indiretta di prompt da repository non attendibili; ad esempio, un repository GitHub compromesso potrebbe indurre un agente a sottrarre segreti o a fornire accesso ai codici sorgenti.

Gartner®, Emerging Tech: The Future of AI Security Is in Securing Agent Actions, Not Prompts

La maggior parte delle soluzioni affronta solo rischi isolati o si concentra esclusivamente sulla scoperta, con conseguente visibilità frammentata, controlli reattivi e punti ciechi in tutta la fase di sviluppo e di esecuzione dell'AI. Sono emerse piattaforme di sicurezza AI per consentire alle organizzazioni di proteggere tutto ciò che costruiscono ed eseguono con l'AI lungo l'intero ciclo di vita dei dati dell'AI.

La sicurezza dell'IA è frammentata

I sistemi di AI introducono nuove superfici di attacco, nuovi vettori di minaccia e nuovi rischi operativi che coinvolgono utenti, applicazioni, dati e i modelli stessi.

Fondamentalmente, i sistemi di AI sono diversi dalle tecnologie che i team di sicurezza hanno tradizionalmente protetto. Sono infatti:

- Più dinamico, adattando il comportamento nel tempo in base agli input, al contesto e all'apprendimento

- Più scalabili, in grado di operare alla velocità e al volume delle macchine piuttosto che al ritmo umano

- Più autonomi, in grado di intraprendere azioni senza un intervento umano diretto

- Più connessi, integrandosi con archivi di dati aziendali, API e flussi di lavoro

Queste caratteristiche aumentano drasticamente il raggio d'azione degli incidenti di sicurezza, rendendo al contempo molto più difficile garantire una sicurezza e una governance efficaci.I team di sicurezza faticano a rispondere a domande critiche sull'utilizzo dell'AI da parte della loro organizzazione:

- A quali dati sensibili possono accedere i sistemi di AI?

- Agenti e LLM sono configurati correttamente?

- I sistemi di AI si comportano in modo anomalo?

- Gli strumenti di AI e il loro utilizzo sono conformi alle normative e ai quadri di riferimento?

Un nuovo approccio

È necessario un approccio basato su una piattaforma tecnica perché monitorare l'utilizzo dell'AI tramite comitati, politiche e fogli di calcolo è troppo manuale e inaffidabile per essere applicato su larga scala.

Una piattaforma non affronta il problema un aspetto alla volta. Invece di concentrarsi sulla creazione di un inventario dei sistemi di AI, ad esempio, un approccio basato su una piattaforma può applicare la gestione della postura di sicurezza dell'AI (AI-SPM) per comprendere le vulnerabilità e le configurazioni errate di ciascun componente dell'inventario, fornendo contemporaneamente funzionalità di rilevamento e risposta dell'AI (AIDR) attraverso il monitoraggio. Da sole, le soluzioni puntuali non sono scalabili per stare al passo con la crescente complessità dell'uso dell'AI.I CISO e i loro team devono disporre insieme di un livello completo di visibilità e controllo.

Nel suo report sulle principali tendenze tecnologiche strategiche per il 2026 , Gartner scrive: “L'adozione dell'AI ha introdotto nuovi rischi per la sicurezza che gli strumenti tradizionali non sono in grado di affrontare. Le organizzazioni devono affrontare minacce come l'iniezione di prompt, la shadow AI e l'uso improprio dei dati sia nell'AI di terze parti che in quella interna.”

Noi di Varonis crediamo che questi rischi non derivino da singoli fallimenti, ma dal modo in cui i sistemi di AI interagiscono dinamicamente con i dati, gli utenti e altri sistemi su larga scala.

In che cosa consiste una piattaforma di sicurezza AI?

Anziché concentrarsi su un singolo controllo o area di rischio, una piattaforma di sicurezza AI (AISP) offre visibilità, applicazione e monitoraggio centralizzati su sistemi di AI, dati, utenti e agenti.Queste piattaforme integrano i programmi di governance attraverso l'applicazione pratica delle policy e l'estensione della sicurezza tradizionale affrontando comportamenti e rischi specifici dell'AI che gli strumenti legacy non sono mai stati progettati per gestire.

Queste piattaforme sono progettate per:

- Scopri l'utilizzo e le implementazioni dell'AI in tutta l'impresa

- Valutare e gestire la postura di sicurezza dell'IA

- Applicare le policy e le misure di protezione in fase di esecuzione

- Rileva e rispondi alle minacce legate all'IA

- Garantire verificabilità e governance per la conformità

Questo approccio completo e basato su piattaforma evolve la sicurezza dell'AI da soluzioni frammentate a un approccio end-to-end all'intero ciclo di vita dell'AI.

Funzionalità principali delle piattaforme di sicurezza AI

Le AISP centralizzate si concentrano su una serie di funzionalità fondamentali che consentono alle organizzazioni di proteggere l'AI durante tutto il suo ciclo di vita, su larga scala. Secondo il rapporto 2025 Gartner Top Strategic Technology Trends for 2026: AI Security Platforms,3 “Un'AISP si basa su due pilastri: il controllo dell'utilizzo dell'AI (AIUC) e la sicurezza delle applicazioni AI (AAIS). L'AIUC protegge l'utilizzo dell'AI di terze parti, mentre l'AAIS protegge le applicazioni AI personalizzate.”

Noi di Varonis riteniamo che queste due aree di funzionalità insieme affrontino sia il modo in cui l'AI viene utilizzata in tutta l'organizzazione, sia il modo in cui vengono protetti i sistemi di AI stessi. Questo approccio a livello di piattaforma riflette la realtà secondo cui il rischio legato all'AI non si limita a un unico livello, ma si estende a utenti, dati, applicazioni, modelli e agenti sempre più autonomi, tutti elementi che devono essere governati e protetti in modo coordinato.

Controllo dell'utilizzo dell'AI

L'AIUC si concentra su come i servizi, gli strumenti e le funzionalità di intelligenza artificiale vengono utilizzati in tutta l'azienda. Questa categoria è progettata per aiutare le organizzazioni a capire dove viene utilizzata l'intelligenza artificiale, a cosa può accedere e se tale utilizzo è in linea con le aspettative di sicurezza, privacy e conformità.

Le funzionalità dell'AIUC includono:

- Rilevamento e inventario AI

- Controllo degli accessi all'AI

- Protezione dei dati sensibili

- Rilevamento dell’utilizzo rischioso dell’IA

- Moderazione dei contenuti

- Test automatizzati di sicurezza dell'AI

Sicurezza delle applicazioni AI

Mentre il controllo dell'utilizzo dell'AI si concentra sul consumo, l'AAIS affronta la sicurezza dei sistemi di AI stessi. Questa categoria riguarda il modo in cui le applicazioni di AI vengono costruite, configurate, integrate e gestite, specialmente man mano che diventano più autonome e interconnesse.

Le funzionalità dell'AAIS includono:

- Rilevamento e inventario AI

- Gestione del livello di sicurezza AI

- Sicurezza MCP (Model Context Protocol)

- Rilevamento di agenti non autorizzati

- Meccanismi di sicurezza multimodali

- Test automatizzati di sicurezza dell'AI

La sicurezza dell'AI non può prescindere dal contesto

Garantire la sicurezza dell'AI non significa più implementare controlli isolati. Richiede invece una piattaforma unificata in grado di collegare l'utilizzo dell'AI al comportamento delle applicazioni, all'accesso ai dati e all'applicazione delle policy.L'utilizzo dell'AI da solo non racconta tutta la storia. Un agente AI potrebbe non sembrare rischioso finché non si capisce a quali dati può accedere e quali controlli sono in atto.

Combinando il controllo dell'utilizzo dell'AI, la sicurezza delle applicazioni di AI e la sicurezza dei dati all'interno di un'unica piattaforma, le organizzazioni possono passare da difese frammentate e reattive a una protezione proattiva adatta a un mondo in cui i sistemi di AI sono più autonomi, interconnessi e parte integrante del business.

Proteggi l'AI e i dati che la alimentano con Varonis Atlas

La sicurezza dell'AI non può basarsi su soluzioni isolate o circoscritte. Man mano che le organizzazioni ampliano l'AI, ne ampliano anche il raggio d'azione. Adottare un approccio unificato alla sicurezza dell'AI che comprenda non solo come si comporta l'AI, ma anche quali azioni può intraprendere e a quali dati può accedere e su quali può agire.

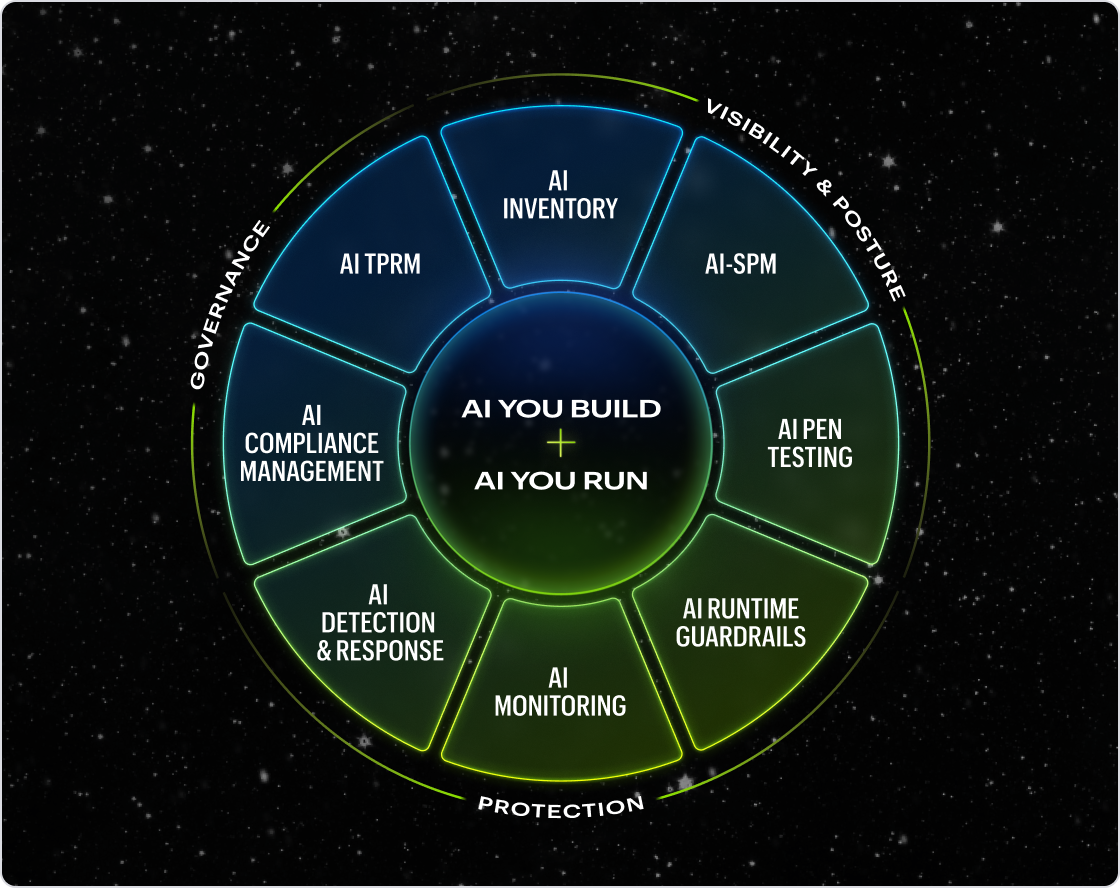

Una panoramica della copertura della piattaforma Atlas lungo l'intero ciclo di vita della sicurezza dell'AI.

Una panoramica della copertura della piattaforma Atlas lungo l'intero ciclo di vita della sicurezza dell'AI.

Varonis Atlas è una piattaforma di sicurezza AI end-to-end che aiuta le organizzazioni a monitorare e controllare l'AI in tutta l'azienda. Atlas è l'unica piattaforma che copre l'intero ciclo di vita della sicurezza basata sull'AI, dall'individuazione e dalla gestione dello stato di sicurezza alla protezione in fase di esecuzione fino alla conformità, il tutto in un'unica soluzione. Atlas si collega a qualsiasi sistema di AI che le organizzazioni costruiscono o gestiscono, comprese piattaforme di AI in hosting, LLM personalizzati, framework agentici, chatbot e AI integrati. E poiché Atlas è stato sviluppato insieme a Varonis Data Security Platform, offre un contesto dati che nessuno strumento di sicurezza AI autonomo può eguagliare.

Varonis Atlas è disponibile oggi. Inizia con una prova gratuita che offre pieno accesso all'inventario AI di Atlas, alla gestione della postura, ai test di sicurezza, ai meccanismi di protezione del runtime e alle funzionalità di reporting di conformità.

Fonti:

- Gartner, Emerging Tech: The Future of AI Security Is in Securing Agent Actions, Not Prompts, Mark Wah, David Senf, 20 febbraio 2026.

- Gartner, Top Strategic Technology Trends for 2026, Gene Alvarez, Bart Willemsen, Frank Buytendijk, Gary Olliffe, Bill Ray, Samantha Searle, Tori Paulman, 18 ottobre 2025.

- Gartner, Top Strategic Technology Trends for 2026: AI Security Platforms, Dennis Xu, Marissa Schmidt, Bart Willemsen, Gene Alvarez, Neil MacDonald, Kevin Schmidt, 18 ottobre 2025.

GARTNER è un marchio registrato di Gartner, Inc. e/o delle sue affiliate.

Nota: questo blog è stato tradotto con l'aiuto dell'AI e corretto da un traduttore umano.

O que devo fazer agora?

Listamos abaixo três recomendações para reduzir os riscos de dados na sua organização:

Agende uma demonstração conosco Veja a usabilidade de Varonis em uma sessão personalizada com base nas necessidades de segurança de dados da sua organização. Responderemos a todas as suas perguntas.

Veja um exemplo do nosso Relatório de Risco de Dados Conheça as ameaças que podem permanecer no seu ambiente. O Relatório da Varonis é gratuito e demonstra claramente como realizar a remediação automatizada.

Siga-nos no LinkedIn, YouTube et X (Twitter) Obtenha insights detalhados sobre todos os aspectos da segurança de dados, incluindo DSPM, detecção de ameaças, segurança de IA, entre outros.