CyberTech Tokyo 2025に世界のサイバーセキュリティリーダーが集結。変化の激しいデジタル脅威の状況について共に探りました。

CyberTechとは、AIの進化や地政学的緊張など予測困難な変化が続く社会において、サイバーセキュリティを中心とした技術の課題と新たなビジネスチャンスに焦点を当てる国際カンファレンスです。

生成AIによるリスクの増大

カンファレンスでは、VaronisのVP, System Engineer, 連邦政府担当であるJustin Wilkins氏、日本担当カントリーマネージャーである並木俊宗氏、イスラエルのエリート部隊8200の元司令官であるAsaf Kochan氏がパネリストとして登壇。ディスカッションの司会は情報セキュリティ大学院の丸山氏が務めました。

パネルでの議題は、大規模言語モデル(LLM)でのプロンプトに機密データが使用される場合に生成AIがもたらすリスクの増大。パネリストたちは、AIが効率と収益化を促進する一方で、深刻な脆弱性ももたらすという点で一致しました。

Kochan氏は「AIに学習させるべきではないものを判断するためにデータをスキャンして分類することが、最も重要で本質的な要素である」と強調しました。Wilkins氏はこの点をさらに強調し、「AI導入における最大のリスクはデータセキュリティである」と述べ、多くの組織が機密データの保管場所と露出状況を把握できていないと警告しました。

Microsoft Copilotのようなツールの登場により、状況はさらに複雑化しています。こういったプラットフォームは、権限のないユーザーに誤って機密情報を漏洩する可能性があります。実際、Varonisの最近の調査では99%の組織がAIに機密情報を晒していることが明らかになりました。

並木氏は、日本企業がAIの活用に際して認識すべき、以下の3つの主なリスクについて概説しました。

- 外部からの攻撃: ハッカーはAIを搭載したチャットボットを悪用し、これまで抜き取るまでに数カ月を要していた機密データを数秒で抜き取れるようになっています。

- 偶発的な侵害:従業員が Copilot などのツールを使用する際、悪意なく意図せずに機密情報(給与詳細や M&A プランなど)にアクセスしてしまうことがあります。

- 内部脅威: 従業員が競合組織に参入する前に、AIを使用して意図的に機密データを収集する事例が増加しています。

データセキュリティを強化する方法

パネリストたちは「データはAIの基盤であり、データがなければAIは存在できない」と強調した上で、機密情報を保護するための主な戦略を概説しました。

データのディスカバリーと分類

組織はデータを保護する前に、構造化データと非構造化データを識別し、分類する必要があります。組織では、顧客名やクレジットカード番号、取引記録などの構造化データに焦点を絞っている場合が多いですが、実際には非構造化データにも機密情報が含まれる可能性があります。メールで送信されたパスワードや社内通信、知的財産などがこれに当たる場合があります。

データの可視化

企業は、誰がどのデータにアクセスできるか、またそのデータの一部が公開されているかどうかを視覚化する必要があります。機密データにラベルを付け、権限管理を実施することで、Copilotのようなツールが機密コンテンツにアクセスするのを防ぐことができます。

アクセスモデルの最適化(規模の適正化)

AI時代のデータセキュリティに不可欠な最小特権の原則。これに従うことで、ユーザーは特定の職務において必要なデータにのみアクセスできるようにし、偶発的な露出を最小限に抑えることができます。これを実行するため、組織は定期的な監査を実施したり、古くなったアクセス権や不要なアクセス権を削除したり、本人確認ツールを導入して原則の執行を自動化したりすることができます。

経営層の意識: 致命的なギャップ

パネルでは、日本企業の経営層特有の課題についても検討しました。

並木氏はこう述べています。「日本企業特有の課題は、全体的なデータセキュリティに責任を負う職務が存在しないことです。特に、IT部門以外の一部の部署でSaaSアプリケーションを直接契約し、管理していることにより、監視が細分化されています。こういったプラットフォームで企業の知的財産が日々生成されているという認識が欠けており、ガバナンスに関する深刻な懸念が生じているのです。」

並木氏は経営層がこういったリスクを正確に認識し、全社的な説明責任の枠組みを確立する必要性を強調。Wilkins氏とKochan氏も、敵対的AIの脅威に関しては海外の経営層の方が敏感であることを指摘しました。

Wilkins氏は、リモートワークやクラウド採用の時代に、ファイアウォールなどの境界ベースの防御は「もはや不十分である」と加え、こういったトレンドが「すでに境界を超えている」と続けました。また、データ中心のセキュリティリーダーシップがますます重要視されていることの明確な例として、各機関に最高データ責任者(CDO)を任命するよう求める米国連邦政府の要求を挙げました。

リモートワークとクラウド採用が進む時代において、[ファイアウォール] はもはや十分ではありません...[AI]のトレンドはすでに境界を超えています。

Justin Wilkins氏,

データ保護の課題

パネリストは、効果的なデータ保護における文化的および技術的な障害について議論しました。

Kochan氏は、主な障害は「人と文化」にあると強調し、セキュリティチームがデータ保護を「自分たちの責任範囲外であると認識することが多く、主体性と責任感の欠如につながる」と指摘しました。

技術的な側面について、Wilkins氏は自動化への抵抗が依然として大きな課題であると指摘しました。この傾向は特に最小特権の原則を導入する際に顕著に表れます。Wilkins氏は「ペタバイト規模の情報を手動で保護することは不可能であり、唯一の実行可能な解決策が自動化である」と強調しました。

これについて並木氏は、「日本企業は新しい技術の波に対応する際に、ヨーロッパやアメリカから5年遅れていると言われがちですが、海外の成功例や教訓から学ぶことで、近道を見つけるチャンスができるのです」と前向きな視点を示しています。

AI時代における安全性の確保

成功している組織は、サイバーセキュリティとデータセキュリティを区別し、クラウドベースの環境とAI主導の運用に適応します。また、侵害が発生した場合に、その事実だけでなく、影響を受けたデータを把握することが不可欠であると理解しています。

AIの導入を加速させる圧力が高まる中、パネリストたちは責任ある実装が重要であると強調しました。企業はスピードよりもガバナンスとリスク管理を優先しなければなりません。

「CISOやセキュリティリーダーは、AI導入に伴うリスクを定量化し、それを経営層アカウントに明確に伝えることで、情報に基づいた意思決定を行い、組織の足並みを揃えることの重要性を強調しています。」

Varonisデータリスクアセスメント(DRA)

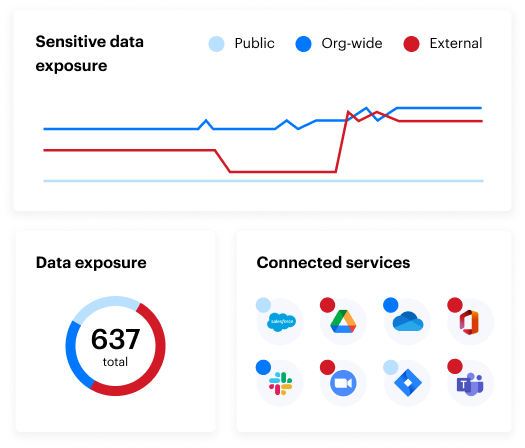

Varonisのセールスエンジニアである成澤氏と日本カントリーマネージャーの並木氏が、データセキュリティの体制を評価および視覚化するのに役立つ無料サービス、「Varonisデータリスクアセスメント(DRA)」について紹介しました。

DRA は、機密データを検出して分類し、アクセス権限を評価し、アクセス制御を自動化することにより、特に AI 活用の準備において重大なリスクを特定します。

具体的には以下を特定します。

- 機密データがどこに保存されているか

- 誰がアクセス権を持っているか

- どのような権限が設定されているか

この情報は、明確で実用的なレポートにまとめられ、企業のデータ漏洩を防ぎ、情報に基づいた意思決定を支援します。

DRAの利用に必要なものはWindowsサーバー1台のみ。包括的なダッシュボードと管理可能なレポートを2~3週間以内に提供します。

並木氏はDRAを使用することで、どのファイルが企業ポリシーや国際規制に違反しているかを正確に評価できると述べ、DRAの価値を強調しました。

データ管理者は、データの全体的な状態や機密情報、およびアクセス権と権限のプロビジョニングを把握できるようになります。このようなデータが明確になることで、企業はAIの導入を進める前に、安心してAIを活用できる環境を整えることができます。

今すぐ無料のVaronis DRAの詳細を確認し、リクエストしましょう。

注:このブログはAI翻訳され、当社日本チームによってレビューされました